Un medio de comunicación europeo decidió utilizar inteligencia artificial generativa para crear artículos a partir de teletipos, lo que llevó a los periodistas a supervisar y corregir el contenido generado. Este cambio se produjo tras la adquisición del medio por un grupo empresarial que mostró desinterés por el trabajo humano.

Los periodistas, en turnos de cuatro horas, evaluaban la calidad de los textos y verificaban datos, con el objetivo de entrenar a la IA. Se esperaba que este proceso durara entre dos y tres meses, tras los cuales los humanos serían reemplazados. La IA generaba titulares absurdos y enviaba notificaciones de última hora de manera arbitraria, lo que provocaba confusión entre los lectores. La calidad de los artículos era deficiente, con párrafos desorganizados y errores de contenido, lo que generaba preocupación sobre la posibilidad de fake news.

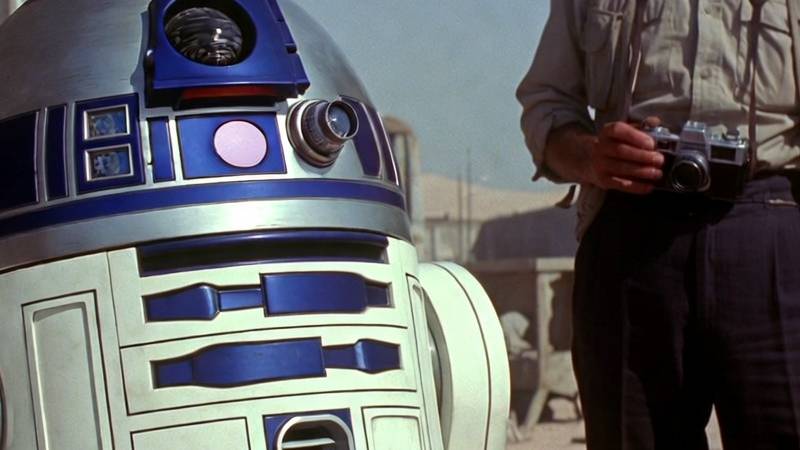

Además, la IA producía imágenes de eventos deportivos con jugadores ficticios. A pesar de las quejas sobre la calidad de las noticias, la dirección del medio insistía en mantener un alto volumen de publicaciones, priorizando la cantidad sobre la calidad. Este enfoque resultó en un periodismo sin sustancia, donde la IA era incapaz de generar contenido relevante y coherente.

¿Es posible que la inteligencia artificial esté desdibujando los límites entre el periodismo y la automatización, comprometiendo la calidad de la información?

.

.

.

RESUMEN BASADO EN EL ARTÍCULO PUBLICADO EN EL PAÍS EL 24 de marzo de 2026. Leer original